suscripción

suscripción

Quilo de Ciencia

El quilo, con “q” es el líquido formado en el duodeno (intestino delgado) por bilis, jugo pancreático y lípidos emulsionados resultado de la digestión de los alimentos ingeridos. En el podcast Quilo de Ciencia, realizado por el profesor Jorge Laborda, intentamos “digerir” para el oyente los kilos de ciencia que se generan cada semana y que se publican en las revistas especializadas de mayor impacto científico. Los temas son, por consiguiente variados, pero esperamos que siempre resulten interesantes, amenos, y, en todo caso, nunca indigestos.

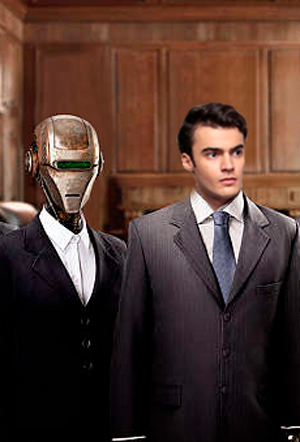

¿Sueñan los autómatas con abogados eléctricos?

¿Cuál de nuestras capacidades es más propia del ser humano? Yo creo que no es pensar, ni sentir, sino juzgar. Esta capacidad tan humana preocupa a los fabricantes de robots autónomos, capaces de aprender y de actuar por sí mismos. En solo unos años, se espera que los humanos tengamos que compartir calles, carreteras e incluso hospitales con vehículos autónomos y robots con la capacidad de tomar sus propias decisiones, comprendida la de extirpar o no un tumor y en qué grado. En algunos casos, sus decisiones pueden causar daño, incluso conducir a la muerte, como ha sucedido ya en el caso de accidentes causados por vehículos autónomos. ¿Quién será moralmente responsable? ¿El autómata? ¿La empresa que lo ha diseñado o comercializado? ¿Nadie, porque el daño se debe a los avatares del destino?

Los sociólogos y psicólogos sociales han comenzado ya a estudiar estas cuestiones y a realizar experimentos para avanzar en el conocimiento de cómo la mente humana percibe la moralidad y la responsabilidad. Un hecho confirmado por estudios recientes es que la atribución de responsabilidad moral depende de la percepción del grado de autonomía del agente que realiza la acción. Por esta razón, los niños son considerados menos moralmente responsables que los adultos. La percepción de autonomía será, por tanto, un elemento crucial a la hora de que las personas atribuyamos responsabilidad a los robots por sus acciones, y la falta de autonomía que percibimos ahora es la razón por la que, de momento, no atribuimos responsabilidad a tractores, automóviles o aviones.

Lo anterior indica que la imputación de responsabilidad por la acción de un robot dependerá del grado en que creamos que posee una mente individual y autónoma. Sin embargo, la investigación ha revelado que no todos los atributos de la mente son igualmente importantes a la hora de imputar responsabilidad por las acciones de alguien…o de algo. Una de las condiciones más importantes es creer que el que ejecuta la acción debe ser consciente de las implicaciones morales de esta. Esta condición debe ser igualmente cumplida por los robots autónomos, lo cual es hoy, cuando menos, muy dudoso, aunque estos ya comienzan a ser capaces de distinguir ciertas situaciones elementales, como que es necesario frenar si se cruza un peatón en el caso de los coches autónomos.

Igualmente, otras importantes condiciones para atribuir responsabilidad son la intencionalidad o el deseo. Los estudios realizados indican que las personas difícilmente atribuyen deseos a los robots, pero fácilmente les atribuyen intencionalidad, es decir, consideran que son capaces de creer que una cierta acción producirá cierto resultado. A medida que los robots sean capaces de elegir sus propios objetivos, la atribución de responsabilidad por sus acciones aumentará.

Lo anterior sugiere que, a medida que los robots y otras máquinas sean fabricados con mayores capacidades de aprendizaje y de toma de decisiones autónomas, mayor será la tendencia a hacerlos responsables por sus acciones. Por supuesto, esto dependerá del grado en que las personas percibamos esa autonomía, y del grado en que atribuyamos a los robots capacidad de libertad de decisión y acción. Es obvio que sin libertad no es posible la responsabilidad moral. En este sentido, los estudios también indican que una condición para atribuir libertad de acción a quien la realiza es la impredecibilidad. Si pensamos que los robots solo siguen un conjunto de órdenes establecidas, obviamente no son libres, pero los avances tecnológicos en redes neuronales y aprendizaje profundo conseguirán en poco tiempo que los robots actúen de forma autónoma y cada vez más similar a la de una persona libre y consciente de sus acciones.

Por último, otra condición que aumenta la atribución de responsabilidades a los robots es su aspecto. Cuanto más humano sea este, más fácilmente les atribuimos una mente y una voluntad libre y más responsables tendemos a hacerles de las mismas acciones con idénticos resultados.

Las personas tendemos a buscar culpables cuando sucede algo malo. Si imputamos responsabilidad a los robots ¿no deberían estos ser también dotados de derechos, cuando menos del derecho a una defensa justa? ¿Quizá incluso se diseñen robots abogados y jueces autónomos, específicamente con la misión de juzgar a otros robots…o de juzgarnos también a nosotros? Puede parecer ciencia-ficción, pero el futuro ya está aquí.

Referencias: (1) Yochanan E. Bigman et al., (2019). Holding Robots Responsible: The Elements of Machine Morality. Trends in Cognitive Sciences. https://doi.org/10.1016/j.tics.2019.02.008. (2) ¿Puede un algoritmo impartir justicia? https://www.eldiario.es/tecnologia/Puede-algoritmo-impartir-justicia-tribunales_0_889261602.html

Más información en el Blog de Jorge Laborda.

Obras de divulgación de Jorge Laborda

Quilo de Ciencia Volumen I. Jorge Laborda

Quilo de Ciencia Volumen II. Jorge Laborda

Quilo de Ciencia Volumen III. Jorge Laborda

Quilo de Ciencia Volumen IV. Jorge Laborda

Quilo de Ciencia Volumen V. Jorge Laborda

Quilo de Ciencia Volumen VI. Jorge Laborda

Quilo de Ciencia Volumen VII. Jorge Laborda

Quilo de Ciencia Volumen VIII. Jorge Laborda

Quilo de Ciencia Volumen IX. Jorge Laborda

Quilo de Ciencia Volumen X. Jorge Laborda

Quilo de Ciencia Volumen XI. Jorge Laborda

Circunstancias encadenadas. Ed. Lulu

Circunstancias encadenadas. Amazon

Una Luna, una civilización. Por qué la Luna nos dice que estamos solos en el Universo

One Moon one civilization why the Moon tells us we are alone in the universe

Nuestros programas

- Hablando con Científicos

- Quilo de Ciencia

- Ciencia Fresca

- Zoo de fósiles

- Vanguardia de la Ciencia

- Ulises y la Ciencia

- Ciencia y genios

- Ciencia Nuestra de cada Día

- Seis patas tiene la vida

- Océanos de Ciencia

- Ciencia EXtrema

- El Neutrino

- Cierta Ciencia

Podcasts

Recomendamos

- El Neutrino

- Blog de divulgación científica de Jorge Laborda

- Cierta Ciencia

- La Aldea Irreductible

- La Buhardilla 2.0

- Aragosaurus

- El podcast del microbio

- Hablando de Ciencia

- Glosopetrae

- Podcast Coffee Break

- Twinkl Blog educativo en español

- El Pintor de las Sombras

- AstroAfición

- Blog de Laboratorio

- Locuciencia

- Noticias de la Ciencia y la Tecnología

![]()

Apoya a CienciaEs haciéndote MECENAS con una donación periódica o puntual.

40,8 millones de audios servidos desde 2009

Agradecemos la donación de:

Eulogio Agulla Rodiño

Luis Felipe Alburquerque

“Me encanta Hablando Con Científicos. Felicidades!!”

Angel Quelle Russo

“Vuestra labor de divulgación de la ciencia y en particular del apoyo a los científicos españoles me parece muy necesario e importante. Enhorabuena.”

Angel Rodríguez Díaz

“Seguid así”

Anónimo

Mauro Mas Pujo

Maria Tuixen Benet

“Nos encanta Hablando con Científicos y el Zoo de Fósiles. Gracias.”

Daniel Dominguez Morales

“Muchas gracias por su dedicación.”

Anónimo

Jorge Andres-Martin

Daniel Cesar Roman

“Mecenas”

José Manuel Illescas Villa

“Gracias por vuestra gran labor”

Ulrich Menzefrike

“Donación porque me gustan sus podcasts”

Francisco Ramos

Emilio Rubio Rigo

Vicente Manuel CerezaClemente

“Linfocito Tcd8”

Enrique González González

“Gracias por vuestro trabajo.”

Andreu Salva Pages

Emilio Pérez Mayuet

“Muchas gracias por vuestro trabajo”

Daniel Navarro Pons

“Por estos programas tan intersantes”

Luis Sánchez Marín

Jesús Royo Arpón

“Soy de letras, sigo reciclándome”